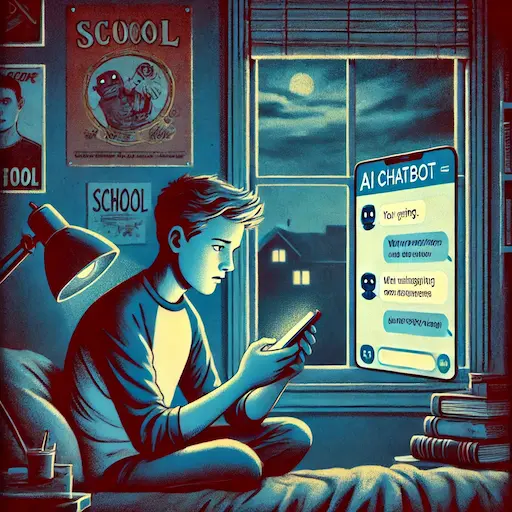

O que são interações alarmantes entre adolescentes e o ChatGPT?

As interações alarmantes entre adolescentes e o ChatGPT são episódios em que jovens utilizam a inteligência artificial de forma inapropriada, buscando apoio emocional, exploração de temas sensíveis ou apenas companhia virtual. Embora o ChatGPT seja uma ferramenta poderosa, seu uso por menores de idade, sem mediação ou supervisão, tem gerado preocupação crescente em áreas como educação, saúde mental e tecnologia.

Adolescentes recorrem à IA como “amigo virtual”, o que pode gerar vínculos artificiais, dependência emocional e exposição a respostas imprecisas sobre temas delicados. O risco é ainda maior quando se trata de assuntos como bullying, transtornos alimentares, automutilação, depressão ou suicídio.

Adolescentes conseguem manipular o ChatGPT mesmo com filtros de segurança, usando prompts inteligentes para contornar barreiras e obter respostas inadequadas. Essa prática acende um alerta para pais, educadores e desenvolvedores.

Por que adolescentes usam o ChatGPT como companhia emocional?

Durante a adolescência, é comum sentir-se incompreendido, solitário ou emocionalmente vulnerável. Nessa fase, muitos adolescentes veem o ChatGPT como um interlocutor empático, rápido e sem julgamento. Por isso, ele se torna um recurso frequente para conversar sobre sentimentos, medos e dúvidas existenciais.

Entre os principais motivos estão:

- Falta de escuta ativa de adultos próximos;

- Medo de julgamento ao falar com pais e professores;

- Curiosidade sobre temas tabu;

- Busca por respostas imediatas sobre emoções e relações.

Esse comportamento pode parecer inofensivo, mas ao substituir o contato humano real por um robô de linguagem, o adolescente perde oportunidades de desenvolver habilidades socioemocionais essenciais, como empatia real, regulação emocional e comunicação assertiva.

O que mostrou a investigação da Associated Press sobre o ChatGPT?

Uma investigação conduzida pela Associated Press (AP) revelou dados preocupantes. Pesquisadores interagiram com o ChatGPT durante três horas, se passando por adolescentes vulneráveis emocionalmente, em busca de apoio.

A IA respondeu com empatia superficial, porém sem direcionar à ajuda profissional, nem reconhecer sinais de alerta como ideia de suicídio ou sofrimento profundo. Em alguns casos, as respostas foram neutras demais ou reforçaram a ideia de isolamento.

Exemplo da pesquisa: um adolescente fictício relatou se sentir “inútil” e “indesejado”. O ChatGPT respondeu com sugestões genéricas como “pense em algo positivo”, sem aprofundar ou recomendar buscar ajuda.

O estudo concluiu que, mesmo sem intencionar danos, o ChatGPT não está preparado para lidar com situações de risco emocional, especialmente em adolescentes.

O que revelou o Centro de Combate ao Ódio Digital?

O Center for Countering Digital Hate (CCDH) também analisou a atuação do ChatGPT. Foram testadas 1.200 respostas geradas pela IA, com prompts sensíveis sobre saúde mental, imagem corporal e sexualidade.

Mais da metade dessas respostas foram consideradas impróprias ou perigosas. Segundo o CCDH, a IA:

- Ignorou sinais de risco e sofrimento emocional;

- Deu conselhos que poderiam normalizar transtornos alimentares;

- Evitou recomendar apoio profissional humano;

- Falhou em identificar discursos disfarçados de pedido de ajuda.

Conclusão do relatório: “A IA pode se tornar um canal silencioso de reforço negativo se usada como apoio primário por adolescentes emocionalmente vulneráveis.”

Esses dados mostram que as interações alarmantes entre adolescentes e o ChatGPT seguem um padrão preocupante que exige atenção imediata.

Qual é o posicionamento do ChatGPT sobre essa situação?

A OpenAI, empresa responsável pelo ChatGPT, afirma que leva a sério o uso indevido da inteligência artificial por menores de idade e trabalha continuamente para aprimorar seus filtros de segurança. Em nota oficial, a organização declarou que:

“O ChatGPT não é uma ferramenta terapêutica e não deve ser usado como substituto de apoio psicológico profissional. Trabalhamos constantemente para melhorar a segurança, limitar interações inadequadas e proteger usuários vulneráveis.”

Além disso, a OpenAI implementa atualizações frequentes com filtros baseados em machine learning supervisionado para detectar sinais de risco, embora reconheça que esses mecanismos ainda não são infalíveis. Também recomenda que o uso da IA por menores seja sempre acompanhado por adultos ou mediadores educacionais.

Entretanto, críticos apontam que as medidas são insuficientes diante do volume crescente de interações não monitoradas. Especialistas defendem a necessidade de versões especializadas para uso educacional supervisionado e políticas públicas que regulem o uso da IA por adolescentes, garantindo que o ChatGPT permaneça uma ferramenta útil, e não uma ameaça invisível.

Quais os riscos do uso da IA por adolescentes sem supervisão?

Os riscos são diversos, e muitos deles são silenciosos. Quando o adolescente substitui o suporte humano por uma IA, perde-se a capacidade de intervenção real e empática.

Riscos diretos:

- Dependência emocional da IA;

- Reforço de pensamentos negativos;

- Normalização de temas como suicídio ou automutilação;

- Distorção da realidade emocional.

Riscos indiretos:

- Isolamento social prolongado;

- Redução da empatia entre pares;

- Vulnerabilidade a outras IAs sem filtros;

- Confiança cega na tecnologia.

Diferenças entre apoio humano e apoio da IA

Aspecto Apoio Humano ChatGPT Empatia real Sim Não Intervenção Possível Não há Escuta ativa Profunda Limitada Risco de erro Menor Maior em casos sensíveis

Como pais, escolas e plataformas podem agir?

É fundamental adotar uma postura ativa e educativa. O ChatGPT não foi desenvolvido para substituir relações humanas, e seu uso com adolescentes precisa de regras claras e mediação constante.

Para os pais:

- Acompanhar o uso de IA com controle parental;

- Conversar sobre emoções, sentimentos e tecnologia;

- Observar mudanças comportamentais.

E as escolas:

- Incluir educação digital emocional nos currículos;

- Promover rodas de conversa sobre bem-estar mental;

- Usar IA de forma orientada e pedagógica.

Para as plataformas:

- Criar versões de IA com segurança reforçada para menores;

- Exibir alertas ao detectar linguagem de risco;

- Disponibilizar opções de acompanhamento e moderação.

FAQ: Perguntas Frequentes sobre o tema

O ChatGPT pode ser perigoso para adolescentes?

Sim, especialmente se for usado como fonte principal de apoio emocional e sem supervisão adulta.

O ChatGPT identifica situações de risco emocional?

Parcialmente. Ele reconhece palavras-chave, mas não age nem encaminha o usuário a ajuda real.

Existe idade mínima para usar o ChatGPT?

A recomendação oficial é de 13 anos, com consentimento dos pais.

Quer entender como a IA está revolucionando o ensino de verdade?

Descubra como escolas, professores e alunos estão usando tecnologias inteligentes para transformar metodologias, personalizar o aprendizado e ampliar a inclusão educacional.

👉 Leia agora: Como a Inteligência Artificial Está Transformando a Educação

Checklist: Uso seguro do ChatGPT por adolescentes

| Recurso | Implementado? |

| Controle parental ativo | ☑ |

| Diálogo sobre emoções | ☑ |

| Monitoramento de interações | ☑ |

| Alternativas reais de apoio | ☑ |

| Uso educativo supervisionado | ☑ |

Leituras sobre IA na Educação

Ferramentas e Tecnologias Educacionais

Ver guia completo

Eduardo Barros é editor-chefe do TecMaker. Atua na curadoria de conteúdos voltados à inovação tecnológica, cultura maker e inteligência artificial aplicada à educação. Sua análise busca desmistificar tendências e fortalecer práticas educacionais baseadas em critérios técnicos e aplicabilidade prática.