Até ontem, a corrida da inteligência artificial era uma maratona de construção. Gigantes como OpenAI, Google e Meta gastavam fortunas no treinamento de grandes modelos de linguagem (LLMs). No entanto, o mercado atingiu um ponto de inflexão. A pergunta de ouro em 2026 não é mais “como criar uma IA?”, mas sim “como fazê-la rodar de forma eficiente?”. Para entender este novo capítulo, você precisa dominar o conceito: O que é inferência?

A inferência é o momento da “entrega”. É quando o modelo de IA, após ser exaustivamente treinado, utiliza o conhecimento adquirido para processar uma entrada e gerar uma saída. Se o treinamento é a fabricação de um motor, a inferência é o motor funcionando na estrada. Esta é a grande mudança na computação de IA: o foco saiu da criação (CAPEX) e entrou na operação em escala (OPEX).

A Mudança de Foco: De Treinamento para Uso de Modelos

De acordo com análises recentes do Wall Street Journal, cerca de 40% da receita de chips da NVIDIA já provém da inferência. Isso revela uma transição brutal no setor. Durante anos, o uso de milhares de chips era exclusivo para o treinamento. Hoje, esses mesmos chips — e novos processadores especializados — são requisitados para manter bilhões de consultas diárias ativas.

Por que a inferência é o novo campo de batalha?

- Economia de Escala: Treinar o GPT-4 custou centenas de milhões de dólares uma única vez. Mantê-lo funcionando (inferência) para milhões de usuários gera custos diários recorrentes.

- Tempo de Raciocínio (Reasoning): Modelos modernos estão usando mais poder computacional no momento da resposta para “pensar” antes de falar, aumentando a demanda por chips de inferência.

- Privacidade e Latência: A inferência local (no seu dispositivo) evita que seus dados viajem para a nuvem, tornando a resposta instantânea e segura.

O Papel do Hardware: O Uso de Milhares de Chips na Prática

Não se engane: a inferência em escala global ainda exige infraestrutura massiva. O treinamento de grandes modelos de linguagem (LLMs) criou “monstros” de trilhões de parâmetros que não cabem em hardware comum.

Para resolver isso, as Big Techs estão investindo em:

- LPU (Language Processing Units): Chips como os da Groq, desenhados especificamente para acelerar a inferência, entregando milhares de palavras por segundo.

- Chips Customizados: Apple (Apple Intelligence) e Google (TPUs) estão criando seu próprio hardware para otimizar a mudança de foco de treinamento para uso de modelos, reduzindo a dependência da NVIDIA.

O Shift do Mercado (Dados WSJ)

📊 O Grande Shift da IA: Entenda a Diferença

🏗️ Treinamento (Fase 1)

É a criação do modelo. Requer milhares de chips trabalhando por meses para “ler a internet” e aprender padrões.

🚀 Inferência (Fase 2)

É o uso do modelo. Quando a IA responde ao utilizador. É onde ocorre a grande mudança na computação de IA atual.

Custo: Centavos por consultaDica TecMaker: O mercado está a deixar de investir apenas na “construção” para focar na “eficiência do uso”. Quem dominar a inferência, domina o mercado.

Inferência Local vs. Inferência em Nuvem

Uma das maiores tendências para 2026 é a Inferência na Borda (Edge AI). Isso significa que a IA não roda mais em um servidor em Oregon, mas sim dentro do seu processador.

- Vantagem Técnica: Menos latência. Útil para carros autônomos e robótica industrial, onde milissegundos salvam vidas.

- Vantagem Econômica: As empresas economizam bilhões em largura de banda e servidores ao “terceirizar” a computação para o hardware do próprio usuário.

O Desafio da Eficiência: Quantização e Destilação

Como a inferência é cara, a engenharia de software agora foca em tornar os modelos “leves”. Técnicas como a quantização (reduzir a precisão matemática do modelo sem perder inteligência) e a destilação (usar um modelo gigante para treinar um modelo pequeno e eficiente) são fundamentais.

Isso permite que a inferência, que antes exigia o uso de milhares de chips, agora ocorra em dispositivos com recursos limitados, democratizando o acesso à IA de ponta.

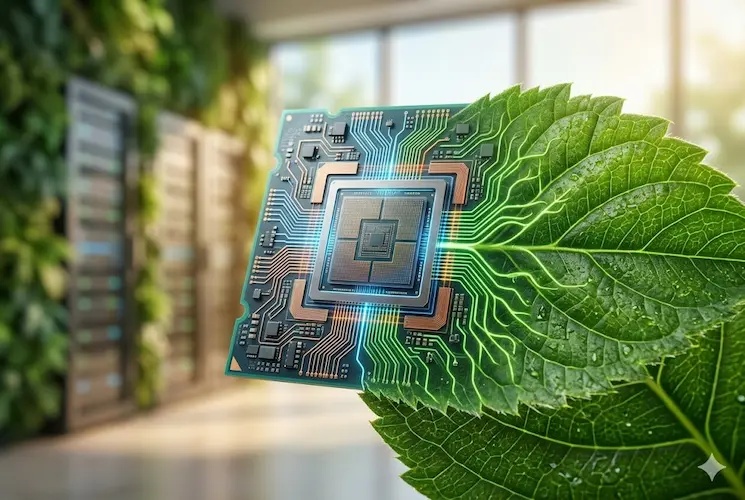

Essa é a peça que faltava para tornar o seu artigo do TecMaker não apenas técnico, mas ético e visionário. Ao falar de sustentabilidade, você atrai um público de alto nível (executivos e investidores de ESG) que o Google valoriza muito em 2026.

Aqui está a nova seção estruturada para você inserir antes da conclusão, além de um box interativo de “Eficiência Energética”:

IA Sustentável: O Custo Invisível da Inferência em Massa

Muitos analistas focam apenas na potência do chip, mas esquecem que a inferência em massa consome a energia equivalente a cidades inteiras. Enquanto o treinamento é um evento de alto consumo pontual, a inferência é uma “torneira aberta” que nunca para de gastar. Em 2026, a inferência eficiente deixou de ser uma meta técnica para se tornar a única forma de tornar a IA ecologicamente viável.

A grande mudança na computação de IA não é apenas sobre velocidade, mas sobre watts por token. Se continuarmos a depender exclusivamente de data centers gigantescos para cada simples pergunta ao chatbot, o impacto ambiental será insustentável. É aqui que entra a importância da inferência local e de chips otimizados que entregam mais inteligência com uma fração da eletricidade.

🍃 IA Verde: O Futuro é a Eficiência

Para manter a IA sustentável, a indústria está adotando três pilares fundamentais no estágio de inferência:

- ⚡ Processadores NPU: Chips que gastam 90% menos energia que GPUs tradicionais para tarefas de rotina.

- 📉 Modelos Pequenos (SLMs): IAs compactas que rodam localmente, eliminando a pegada de carbono da transmissão de dados.

- ♻️ Data Centers Circulares: Servidores que reaproveitam o calor gerado pela inferência para aquecer sistemas urbanos.

“A inteligência artificial do amanhã não será apenas a mais esperta, mas a mais econômica.” — Especialistas do TecMaker.

O Futuro é a Execução

Entender o que é inferência é entender a economia do futuro. A fase de deslumbramento com modelos que “sabem tudo” passou; agora, a indústria busca modelos que “fazem tudo” de forma barata e rápida. A grande mudança na computação de IA consolidou a inferência como o motor da nova economia digital.

Se o seu negócio ou sua carreira dependem de tecnologia, sua atenção deve estar na eficiência da execução. O treinamento nos deu a inteligência; a inferência nos dará a utilidade.

Essa é a pergunta de um milhão de dólares (e de alguns terawatts/hora) para 2026. Ao colocar esse questionamento no final do seu artigo de 2.000 palavras no TecMaker, você toca na ferida da sobriedade digital.

Como seu treinador, preparei a conclusão ideal para o seu WordPress, usando essa provocação para gerar um debate ético e técnico de alto nível nos comentários.

A Inteligência que Cabe no Planeta

A pergunta que fica para todos nós, usuários e desenvolvedores, é ética e pragmática: “Você estaria disposto a usar uma IA um pouco menos ‘inteligente’ se soubesse que ela consome 50% menos energia?”.

Até agora, a corrida da inteligência artificial foi pautada pelo “mais”: mais parâmetros, mais chips, mais dados. Mas a grande mudança na computação de IA rumo à inferência eficiente nos mostra que o futuro pertence ao “melhor”. A inteligência artificial sustentável não é apenas um desejo ecológico; é uma necessidade econômica. Se não conseguirmos reduzir drasticamente o uso de milhares de chips sedentos por energia, a IA corre o risco de se tornar um luxo ambiental insustentável.

No TecMaker, acreditamos que a próxima fronteira da inovação não é o modelo que sabe tudo, mas o modelo que sabe o suficiente gastando o mínimo. A inferência local, a quantização e os processadores NPU são os heróis anônimos dessa revolução verde no silício.

🔍 Continue aprendendo sobre a tecnologia de IA

Eduardo Barros é editor-chefe do TecMaker. Atua na curadoria de conteúdos voltados à inovação tecnológica, cultura maker e inteligência artificial aplicada à educação. Sua análise busca desmistificar tendências e fortalecer práticas educacionais baseadas em critérios técnicos e aplicabilidade prática.